-

Брой отговори

10092 -

Регистрация

-

Последен вход

-

Days Won

94

makebulgar last won the day on Април 5

makebulgar има най-харесвано съдържание!

Всичко за makebulgar

Лична информация

-

Пол

Мъж

-

Пребиваване

България

-

Интереси

история, археоастрономия, лингвистика, археология, религия, слънчеви култове, антропология, популационна генетика, биохимия, медицина, роботика, изкуствен интелект, астрономия, инженерни науки

Последни посетители

39272 прегледа на профила

makebulgar's Achievements

-

Това, че в Персия са ползвали уйгурската версия на китайския животински календар не означава, че персйския календар по онова време е съчетавал 12-годишен животински цикъл. Използван е паралелно, а не като някакъв хибрид. При това по време на Илханата, водещ в администрацията е бил монголския календар, а не джалали. Ето какво е мнението на Базен за двойните датировки в Персия: "В дискусията си за двойките дати животно-хиджрз, произлизащи от тюрко-монголската среда, Базен стига до заключението, че в случаи на съмнение, когато двете дати не съвпадат, обикновено е най-добре да се разчита на датата, дадена според календара с дванадесет животни, а не на еквивалента на хиджрз, реконструиран a posteriori. Неговото мнение се основава на доказателства за погрешни изчисления или „несъвършенството на консултираните таблици“.

-

Микола е действал с Бръснача на Окам. И е дал най-простото и логичо решение на проблемите. Всички останали варианти са по-сложни за доказване. Разбира се, никой не ви ограничава да вярвате в някакви тези, които определяте като предпоставени. Просто не забравяйте, че има някои неща, които са най-малкото съпротивление в Бръснача на Окам, и тях няма как да ги пренебрегнете, защото без тях новите тези ще станат псевдонаука. Като се отива към фантастика от рода на Сигор, не е Шегор и значи Тигър, или като се търси на всяка цена решение различно от това на Микола, нещата вече не изглеждат добре. А въпросът дали годината започвала март или септември е толкова маловажен, че ми е чудно защо си губите времето с него. Дребнави сметки са това, опитвайки се да се докаже нещо чрез сметки, а не чрез лингвистика. И за да излязат сметките ще се търси кой автор смятал с +1 година или с -1 година, а ако пак не излязат сметките ще изкараме, че просто българите не са знаели реда на животните и ще тръгнем да търсим къде са го объркали те.

-

Само дето в Иран животинския календар никога не е бил основна календарна система, и никой не е наричал датировката по него "по ирански", а това означава, че за смите иранци и намало голямо значение маймуна ли е, кокошка ли е, особено ако става на въпрос за монголски канцеларски сведения. Докато при нас си имаме пряко сведение издялано на камък, че животинския календар е бил основен. Имаме разбира се и първана част на Именника, където си се следва 12-годишния цикъл, и няма пропуснати животински години.

-

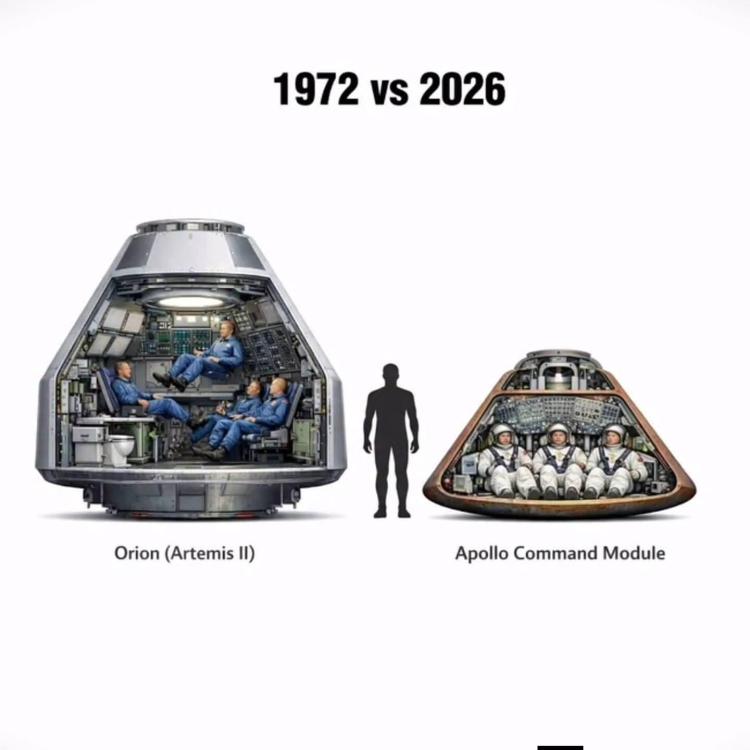

Може са не са конкурентно способни в момента, но имат планове да станат. В Седмицата на Космоса (провеждана ежегодно от 6 до 12 април) Роскосмос обяви план за настигане на лидерите в космическите технологии. Русия възнамерява да се превърне в една от трите най-големи космически сили в света по отношение на „възвръщаемост и технологии“ през следващите три до четири години, заяви Григорий Максимов, заместник-генерален директор по производството в Роскосмос, на Руския космически форум. „През следващите три до четири години ние въведохме всички необходими мерки не само да наваксаме, но и да се превърнем в една от трите най-големи космически сили в света по отношение на възвръщаемостта и технологичния напредък на нашите продукти“, каза той. „В близко бъдеще ще можем да подкрепим бързия растеж на частния и публичния бизнес по отношение на нашата инфраструктура и готовност за значително увеличаване на броя на пусканията на достъпна цена“, обясни Максимов (цитиран от Интерфакс). По-рано Генадий Красников, ръководител на Руската академия на науките, заяви, че приоритетните области на космическите изследвания на Русия остават търсенето на живот във Вселената, изследването на слънцето, мисията до Венера и лунната програма. Той отбеляза, че страната разработва проекти за нови обсерватории, включително „Спектр-УВ“ и „Милиметрон“, които в крайна сметка са предназначени да заменят телескопите „Хъбъл“ и „Джеймс Уеб“. https://www.rbc.ru/rbcfreenews/69d7638e9a79470af968b0b7?utm Максимов също така определи три ключови области, в които все още е необходимо да се свърши значителна работа за постигане на заявените цели. Едната е дигитализацията на всички етапи от производството на ракети (проектиране, тестване и експлоатация), което ще помогне за ускоряване на процесите и намаляване на разходите за производство на ракети-носители. Втората област е внедряването на нови технологични решения, включително адитивно производство, топлопроводимост и нови структурни материали. Третата област е нов подход към производството на ракети. Максимов отбеляза, че копирането на съветските ракети от 70-те и 80-те години на миналия век ще попречи на Русия да се конкурира успешно с водещите космически сили. В заключение той заяви, че Роскосмос залага на многократната употреба, дигитализацията и технологичната модернизация като основа за бъдещия растеж на руското космическо проучване. Днес беше обявено също, че Русия и Съединените щати са се споразумели да удължат експлоатацията на първия (най-стария) модул „Заря“ до 2032 г. Функционалният и товарен модул „Заря“ е изстрелян в орбита на 20 ноември 1998 г., а впоследствие от него е построена цялата станция. За Седмицата на космоса беше пусната марка, отбелязваща 65-годишнината от полета на Гагарин.

-

Явно Роскосмос не се занимават да хвалят конкуренцията. По същия начин няма да чуете БТВ или НОВА да хвалят конкурентите си, и ако се наложи да съобщят за някоя чужда новина ще говорят завоалирано и непряко с нещо от рода на "според друга медия". Конуренцията не се рекламира в никакъв случай в капиталистическата икономика.

-

Хората ядящи месо от изследването е по-вероятно да не ядат същевременно тестени богати на въглехидрати рани, и ултрапреработени и пържени храни и меса, а това също може да е фактор. Тоест има ефект от заместване. С месо ако заместиш индустриалните преработени храни и салами, рисковете ти могат да се снижат. Но изследването не показва какво е положението при вегани и вегетарянци. Може при тях риска да е още по-нисък.

-

В общи линии набюдавана е корелация, а не причинно следствена връзка между яденето на месо при хора с аполипоротеин Е с алеал е4 (APOE-е4) и сърдечно-съдови заболявания, деменция и алцхаймер. Причините не са установени, като може наблюдаваните корелации да са грешки в методологията на проучванията, тъй като изследванията не се съобразяват с възрастта, тютюнопушенето, алкохола, и други рискови фактори, които влияят на същите заболявания. Аполипопротеин Е е протеин, участващ в метаболизма на мазнините в тялото и е от семейство мазнини-свързващи протеини. В кръвообращението той присъства като част от няколко класа липопротеинови частици, включително хиломикронови остатъци, VLDL, IDL и някои HDL. Аро-Е взаимодейства значително с рецептора за липопротеини с ниска плътност (LDLR), който е от съществено значение за нормалната обработка (катаболизъм) на богати на триглицериди липопротеини. В периферните тъкани се произвежда предимно от черния дроб и макрофагите и медиира метаболизма на холестерола. В централната нервна система Аро-Е се произвежда главно от астроцити и транспортира холестерол до неврони чрез Аро-Е рецептори, които са членове на генното семейство на рецепторите за липопротеини с ниска плътност. Аро-Е е основният носител на холестерол в мозъка. APOE-е4 е с честота 13,7% в свеновен мащаб, като се приема, че е замесен в гърчове, диабет тип 2, сепсис, миокарден инфаркт, съдова деменция, вирус на херпес симплекс 1, хипертония, атеросклероза, болест на Алцхаймер, нарушена когнитивна функция, намален обем на хипокампуса, ХИВ, ускорено прогресиране на заболяването при множествена склероза, неблагоприятни резултати след травматично мозъчно увреждане, исхемична мозъчно-съдова болест, сънна апнея, както удължаване, така и скъсяване на теломерите, и намален растеж на неврити. APOE улеснява транспорта на липиди, мастноразтворими витамини и холестерол през кръвта. Към 2012 г. вариантът E4 е най-големият известен генетичен рисков фактор за спорадична болест на Алцхаймер (БА) с късно начало в различни етнически групи. Вариантът E4 обаче не корелира с риска във всяка популация. Нигерийците имат най-високата наблюдавана честота на алела APOE4 в световните популации, но БА е рядко срещана сред тях. Това може да се дължи на ниските им нива на холестерол. Кавказките и японските носители на два алела E4 имат между 10 и 30 пъти по-висок риск от развитие на БА до 75-годишна възраст в сравнение с тези, които не носят никакви алели E4. Това може да се дължи на взаимодействие с амилоид. Има специфичен за пола ефект, тъй като наличието на APOE4 увеличава риска от БА повече при жените, отколкото при мъжете. Болестта на Алцхаймер се характеризира с натрупване на агрегати от пептида бета-амилоид, чието разграждане се усилва от аполипопротеин Е, както в клетките, така и между тях. Изоформата APOE-ε4 не е толкова ефективна, колкото другите, в насърчаването на това разграждане, което води до повишена уязвимост към болестта на Алцхаймер при индивиди с тази генна вариация. Амилоидната хипотеза за болестта на Алцхаймер е поставена под въпрос, а статия от 2021 г. в Science твърди, че „Точно както премахването на дима не гаси пожар, намаляването на амилоидните плаки може да не повлияе на протичането на болестта на Алцхаймер.“ Ролята, която вариантът E4 играе, все още може да бъде напълно обяснена дори при липса на валидна амилоидна хипотеза, като се има предвид фактът, че сигнализирането на рилин се очертава като един от ключовите процеси, участващи в болестта на Алцхаймер, и е показано, че вариантът E4 взаимодейства с ApoER2 , един от невронните рецептори на рилин, като по този начин възпрепятства сигнализирането на рилин. Въпреки че 40–65% от пациентите с болестта на Алцхаймер имат поне едно копие на алела ε4, APOE4 не е определящ фактор за заболяването. Поне една трета от пациентите с болестта на Алцхаймер са APOE4- отрицателни, а някои хомозиготи с APOE4 никога не развиват заболяването. Въпреки това, тези с два алела ε4 имат до 20 пъти по-висок риск от развитие на болестта на Алцхаймер. Има също така доказателства, че алелът APOE2 може да играе защитна роля при болестта на Алцхаймер. По този начин, генотипът, който е най-изложен на риск от болестта на Алцхаймер и в по-ранна възраст, е APOE4,4. Използвайки генотип APOE3,3 като ориентир (като лицата, които имат този генотип, се считат за имащи ниво на риск от 1,0) и само за белите популации, индивидите с генотип APOE4,4 имат коефициент на вероятност от 14,9 за развитие на болестта на Алцхаймер. Хората с генотип APOE3,4 имат коефициент на вероятност 3,2, а хората с копие на алел 2 и алел 4 (APOE2,4) имат коефициент на вероятност 2,6. Хората с по едно копие на алел 2 и алел 3 (APOE2,3) имат коефициент на вероятност 0,6. Хората с две копия на алел 2 (APOE2,2) също имат коефициент на вероятност 0,6. Въпреки че е установено, че ApoE4 значително увеличава вероятността даден човек да развие болестта на Алцхаймер, проучване от 2002 г. заключава, че при хора с каквато и да е комбинация от алели APOE, високият серумен общ холестерол и високото кръвно налягане в средата на живота са независими рискови фактори, които заедно могат почти да утроят риска индивидът по-късно да развие болестта на Алцхаймер. Въз основа на своите данни някои изследователи предполагат, че понижаването на нивата на серумния холестерол може да намали риска от болестта на Алцхаймер, дори ако човек има два алела ApoE4, като по този начин намалява риска от девет или десет пъти вероятността от развитие на болестта на Алцхаймер до само два пъти вероятността.

-

Вести.бг са майстори в съставяне на дълги статии от кратки новини, чрез добавяне на напълно несвързани с основната тема допълнителни теми. Причините за наблюдавания ефект може да са много - витамин В12, по-високия прием на желязо или друга. Но ако си осигуряваш тези неща с по-пълноценно меню няма да има нужда да ядеш месо. Проучването е: Jakob Norgren, Adrián Carballo-Casla, Giulia Grande, Anne Börjesson-Hanson, Hong Xu, Maria Eriksdotter, Erika J. Laukka, Sara Garcia-Ptacek. Meat Consumption and Cognitive Health by APOE Genotype. JAMA Network Open, 2026; 9 (3): e266489 DOI: 10.1001/jamanetworkopen.2026.6489

-

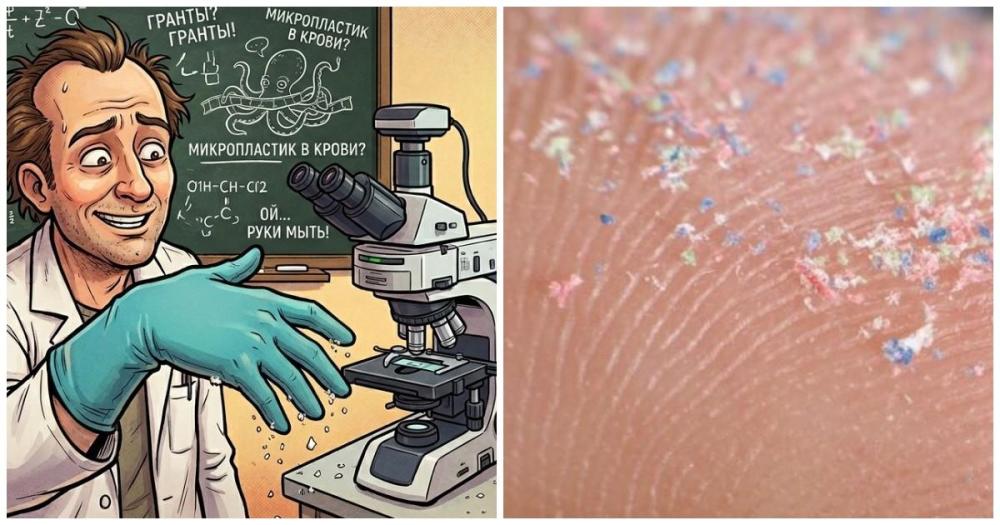

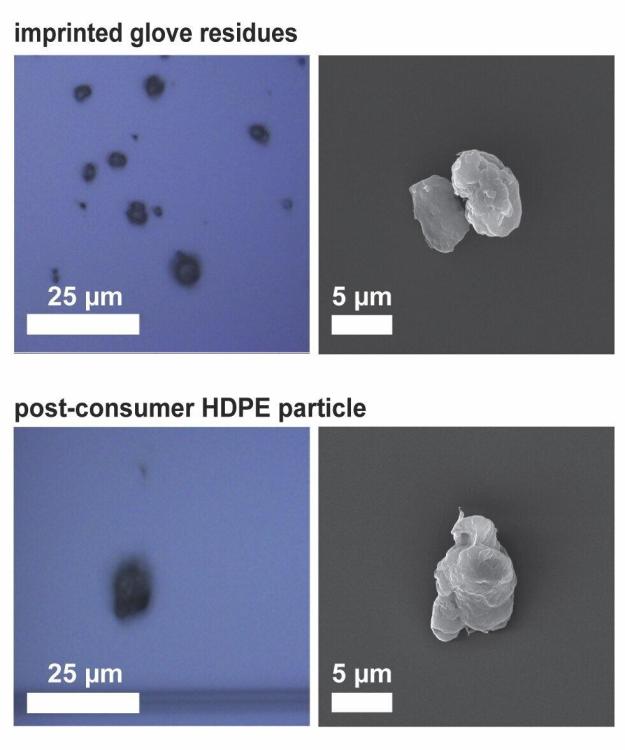

Години наред британски (и не чак толкова британски) учени ни разказват ужасяващи истории за микропластмасите. Те са открити в Марианската падина, в арктическия лед, в бирата и дори на места, където слънцето не грее. Еколозите бяха във възторг, грантовете валяха, а човечеството се готвеше да се превърне в човечета от Лего. Нитрилните и латексовите ръкавици, които учените носят, докато измерват микропластмаси, могат да доведат до потенциално надценяване на малките замърсители, според проучване на Университета в Мичиган. Проучването установи, че ръкавиците могат неволно да замърсят лабораторното оборудване, което учените използват за измерване на микропластмаси във въздух, вода и други проби, с непластични частици, наречени стеарати. Изследователите от Мичиганския университет Маделин Клъф и Ан Макнийл предлагат вместо това да се носят ръкавици за чисти помещения, които отделят по-малко частици. Остатъци от нитрилни или латексови ръкавици могат неволно да замърсят лабораторното оборудване, което учените използват за измерване на микропластмаси във въздух, вода и други проби, с непластмасови частици, наречени стеарати. Стеаратите, вид сол, са химически подобни на структурно ниво на микропластмасите. Те също така изглеждат подобни визуално. Снимка: Madeline Clough/University of Michigan Стеаратите са соли или частици, подобни на сапун. Производителите покриват ръкавиците за еднократна употреба със стеарати, за да улеснят отлепването им от формите, използвани за оформянето им. Но стеаратите също са химически много подобни на някои микропластмаси, според изследователите, и могат да доведат до фалшиво положителни резултати, когато изследователите търсят замърсяване с микропластмаси. Това не означава, че няма замърсяване с микропластмаси, бързат да заявят изследователите от Мичиганския университет. „Може би надценяваме микропластмасите, но не би трябвало да има такива. Все още има много такива и това е проблемът“, каза Макнийл, старши автор на изследването и професор по химия, макромолекулна наука и инженерство в Мичиганския университет и Програмата за околна среда. Като изследователи на микропластмаси, търсещи микропластмаси в околната среда, „търсим иглата в купа сено, но всъщност не би трябвало да има игла“, каза Клъф, наскоро завършил докторантура в Мичиганския университет. Работата, ръководена от Клъф, е публикувана в списанието RSC Analytical Methods. Проучването е подкрепено от грант от изследователската инициатива „Meet the Moment“ на Колежа по литература, наука и изкуства към Мичиганския университет. Дива гонитба на микропластмаси Проучването започна, когато Клъф работеше по съвместен проект, включващ докторанти и преподаватели от катедрите по химия, статистика и климатични и космически науки на Мичиганския университет, за да изследват микропластмасите в атмосферата на Мичиган. За целта Клъф и Макнийл се обърнаха към сътрудниците си в изследването - професора по химия в Мичиганския университет Анди Олт и докторантите Ребека Пархам и Абигейл Аяла, за да им помогнат с вземането на проби от въздуха. Изследователите са използвали пробоотборници за въздух, снабдени с метален субстрат. Въздухът преминава през пробоотборника и частици от атмосферата се отлагат върху субстрата. След това, използвайки светлинна спектроскопия, изследователите са в състояние да определят какъв вид частици се намират върху субстрата. Клъф подготвила субстратите, носейки нитрилни ръкавици, което се препоръчва от насоките в литературата в областта на микропластмасите. Но когато тя изследвала субстратите, за да оцени колко микропластмаси е уловила, резултатите били хиляди пъти по-големи от очакваното. „Това доведе до дива гонитба в опитите да разберем откъде е възможно да е дошло това замърсяване, защото просто знаехме, че това число е твърде високо, за да е вярно“, каза Клъф. „По време на процеса на установяване – дали е пластмасова бутилка с пулверизатор, дали е частици в атмосферата на лабораторията, където подготвях субстратите – най-накрая го проследихме до ръкавици.“ Изследователите са разработили експеримент, за да установят колко широко разпространен е проблемът. Те са тествали седем различни вида ръкавици, включително нитрилни, латексови и ръкавици за чисти помещения, както и най-често срещаните техники, които изследователите на микропластмаси използват за идентифициране на микропластмаси. Експериментът имитира вида контакт, който би се получил в изследователска среда между ръката на изследователя с ръкавица и точка на контакт. Това би включвало филтър или предметно стъкло – всяка технология, която изследователят би използвал по време на изследване на микропластмаси. Те открили, че средно ръкавиците са дали около 2000 фалшиви положителни резултата на милиметър квадратен площ. „Видът контакт, който се опитахме да имитираме, засяга всички видове изследвания на микропластмасите“, каза Клъф. „Ако контактувате с проба с ръка в ръкавица, вероятно предавате тези стеарати, които биха могли да надценят резултатите ви.“ Изследователите също така установили, че ръкавиците за чисти помещения отделят най-малко частици – вероятно защото ръкавиците за чисти помещения се произвеждат без стеаратно покритие, което им позволява да се използват в „ултрачисти“ приложения. Отстраняване на фалшиви положителни резултати Изследователите разработили друг експеримент, за да определят дали са в състояние да различат как изглежда истинска микропластика от една от стеаратните соли от ръкавиците. Използвайки сканираща електронна микроскопия, както и светлинна микроскопия, те установили, че стеаратът е визуално неразличим от полиетилена, пластмасата, на която прилича. Но Клъф и Макнийл успяха да открият методи, в сътрудничество с докторанта Едуардо Очоа Ривера и професора по статистика в Мичиганския университет Амбудж Тевари, които могат да разграничат фалшиво положителните резултати от ръкавицата от микропластмасите в околната среда. Това може да помогне на изследователите да преразгледат потенциално замърсени набори от данни. „За изследователите на микропластмаси, които разполагат с тези засегнати набори от данни, все още има надежда да ги възстановят и да открият истинско количество микропластмаси“, каза Клъф. Изследователите казват, че тяхното проучване подчертава значението на химичните изследователи в областта на микропластмасите, които биха могли да разпознаят разликата в химическата структура на пластмасите спрямо други замърсители. „Тази област е много трудна за работа, защото има пластмаса навсякъде“, каза Макнийл. „Но затова се нуждаем от химици и хора, които разбират химическата структура, за да работят в тази област.“ https://news.umich.edu/nitrile-and-latex-gloves-may-cause-overestimation-of-microplastics-u-m-study-reveals/

-

- 1

-

-

Генералното ми обобщение относно могилите, че са крайпътни, има съвсем друга логика, различна от тази, която влага П.Георгиев в статията. Според него има някакви сходства с традиции от изтока при тюрки и други алтайци, които имат подобни могили покрай пътища. Според мен описаното на Търновската колона не е изключение, а е било традиция, която се вижда при други могили.